Naukowcy analizują olbrzymie ilości danych wyprodukowanach w ramach jednej z największych symulacji kosmologicznych w historii przeprowadzonej przez naukowców z Argonne National Laboratory.

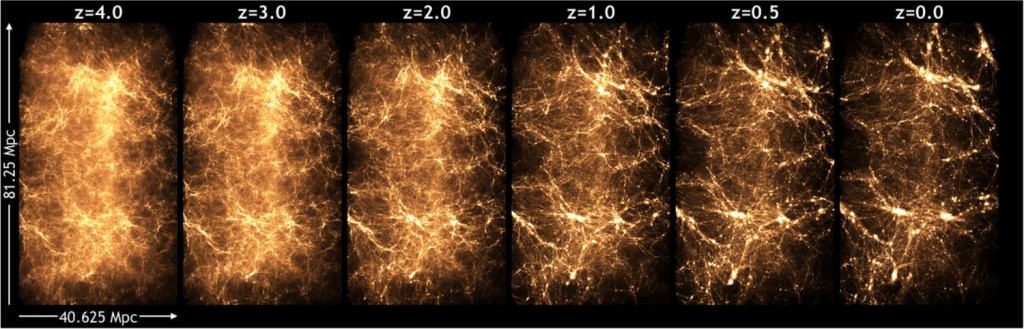

Symulacja przeprowadzona na superkomputerze Titan w Oak Ridge National Laboratory pozwoliło na stworzenie modelu ewolucji wszechświata od zaledwie 50 milionów lat po Wielkim Wybuchu do dnia dzisiejszego – od najmłodszych dni wszechświata do obecnej dorosłości. W ciągu 13,8 mld lat materia we Wszechświecie grupowała się i tworzyła galaktyki, gwiazdy i planety – jednak dotąd nie wiemy jak dokładnie wyglądał ten proces.

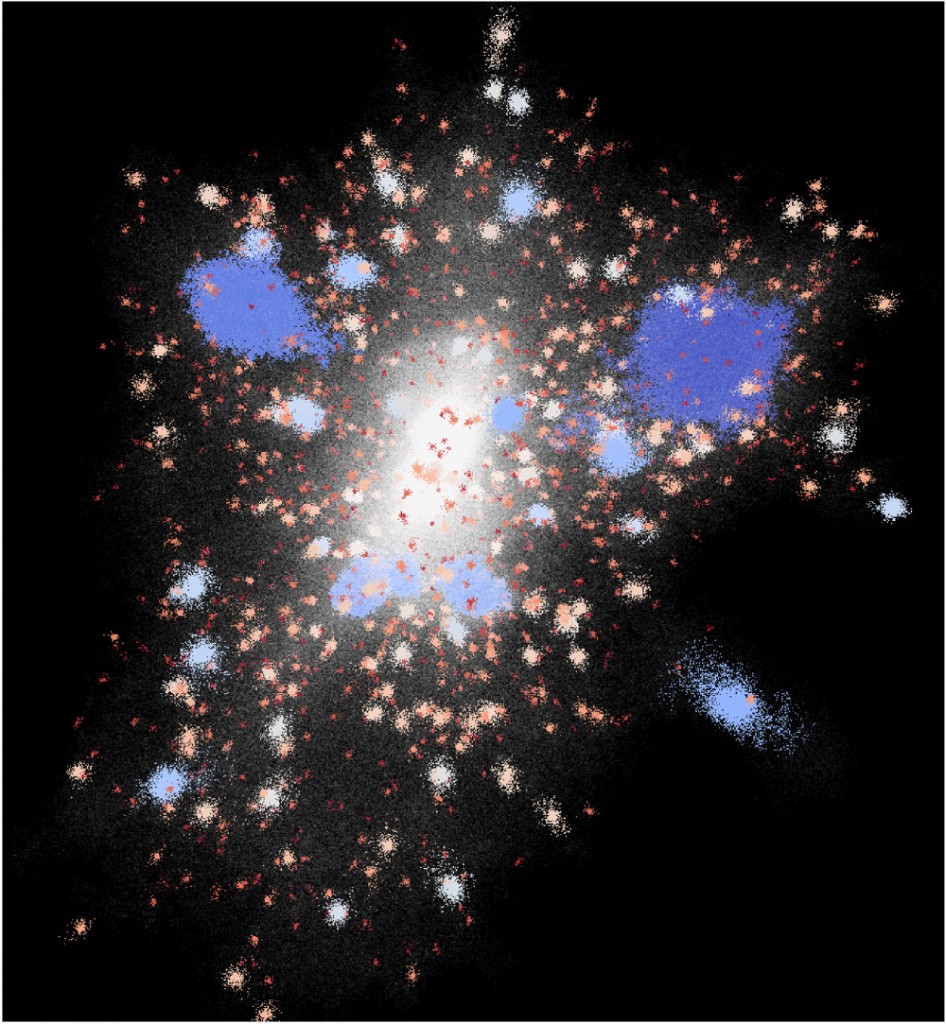

Tego rodzaju symulacje pomagają naukowcom zrozumieć ciemną energię, rodzaj energii, który wpływa na tempo rozszerzania wszechśwata oraz rozkład galaktyk, składających się ze zwyczajnej materii oraz ciemnej materii – tajemniczej materii, której nie jest w stanie jak dotąd zmierzyć żaden instrument.

Obszerne przeglądy nieba wykonywane silnymi teleskopami, np. Sloan Digital Sky Survey oraz nowy, dokładniejszy Dark Energy Survey pokazują naukowcom gdzie były galaktyki i gwiazdy po raz pierwszy emitując światło. Natomiast przeglądy kosmicznego promieniowania tła – światła z czasów gdy wszechświat miał zaledwie 300 000 lat, pokazują nam zupełne początki wszechświata – „gdy był bardzo jednorodny,” mówi Katrin Heitmann, fizyczka z Argonne, która przeprowadziła symulację.

Symulacja wypełnia lukę w naszej wiedzy o wszechświecie między tymi dwoma okresami. „Grawitacja oddziałuje na ciemną materię, która zaczyna się zagęszczać w miejscach, w których później powstaną galaktyki,” powiedziała Heitmann.

Symulacja nazwana Q Continuum obejmowała symulację 500 miliardów cząstek – po podzieleniu wszechświata na sześciany o długości boku 100 000 km. Dzięki temu jest to jedna z największych symulacji kosmologicznych o tak wysokiej rozdzielczości. Do jej wykonania wykorzystano ponad 90% zasobów superkomputera. Dla porównania, tylko 1% prac przeprowadzanych na superkomputerze wykorzystuje więcej niż 90% jego zasobów.

„To bardzo bogata symulacja,” mówi Heitmann. „W danych z przeglądu możemy szukać odpowiedzi dlaczego galaktyki grupują się w taki sposób oraz jakie fundamentalne procesy fizyczne wpływają na formowanie się takich struktur.”

Analiza dwóch i pół petabajta wygenerowanych danych już się rozpoczęła i będzie trwała przez kilka kolejnych lat. Szczegóły przeprowadzanych prac opublikowano w artykule pt. „The Q continuum simulation: harnessing the power of GPU accelerated supercomputers” w sierpniowym wydaniu czasopisma Astrophysical Journal Supplement.

Źródło: ApJS